各大云平台满血版 DeepSeek 体验

见字如面,与大家分享实践中的经验与思考。

最近通过体验一些云厂商提供的满血版 DeepSeek 大模型来辅助编程,但是响应速度不尽人意,所以测试下目前几个主流的云平台,评估下哪些便于后续的学习和研究。

以下大平台都提供了 DeepSeek 满血版的 R1 和 V3 的模型 ,分别是:

1、DeepSeek 官方

2、硅基流动:免费赠送 14 元。

3、阿里云百炼:R1 和 V3 各100万额度,有效期半年内。

4、火山引擎 | 火山方舟:R1 和 V3 各 50 万免费额度,无时间限制,用完后需要充值。

5、百度千帆 ModelBuilder :无限制,限时免费,截止 2 月 18 日 23:59:59。

6、英伟达 Nvidia :1000 次调用额度。

因 DeepSeek 官网截止 2月 18 日 依然无法购买,先排除。

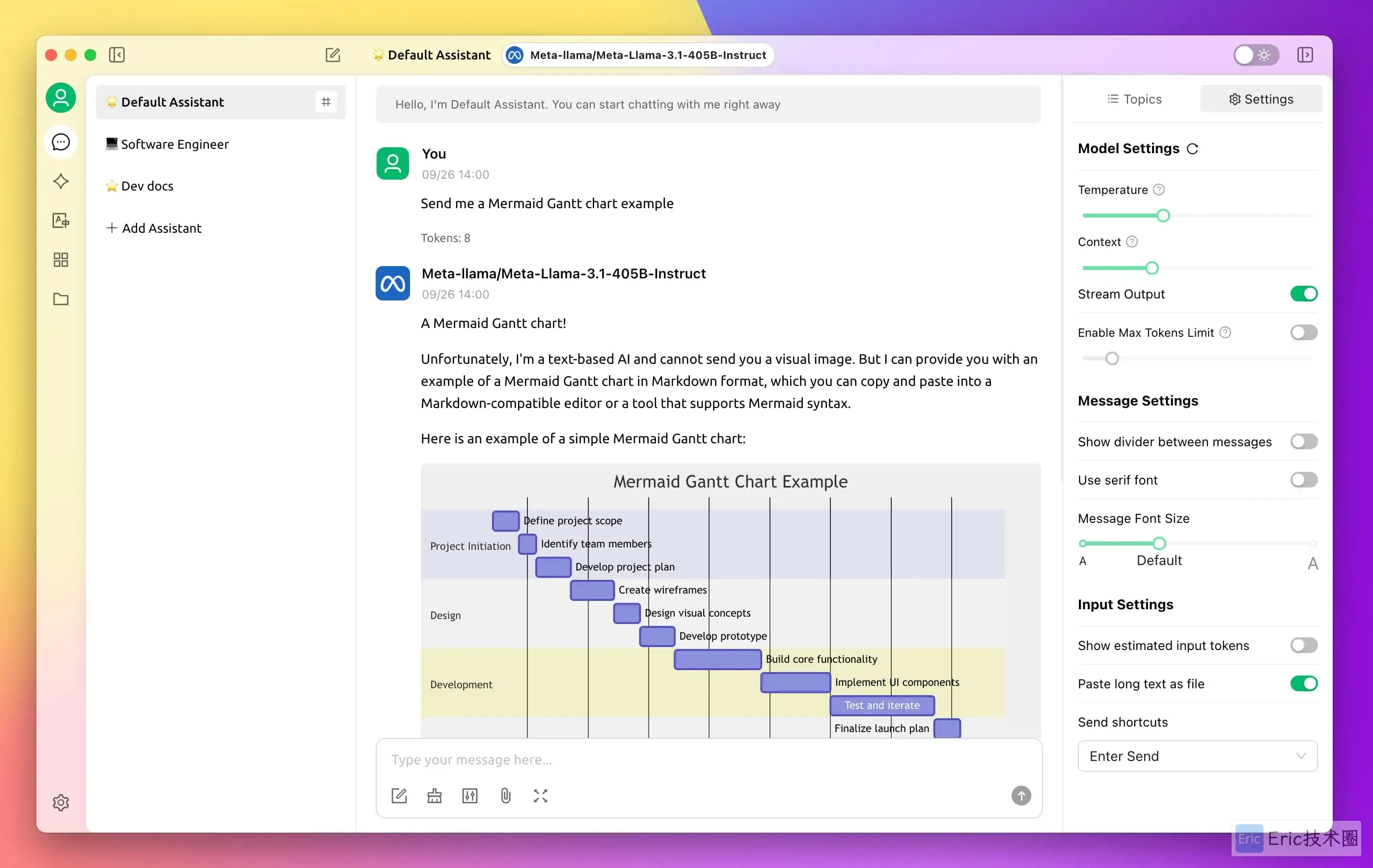

Cherry Studio 安装

项目主页:https://github.com/kangfenmao/cherry-studio 下载地址:https://github.com/kangfenmao/cherry-studio/releases

Cherry Studio 内置众多服务商 同时也支持其他兼容 OpenAI/Anthropic 等API格式的服务商接入。

主要功能介绍:

大模型对话:除了基础的AI对话,文档或图像对话,甚至是公式和HTML预览都能帮你完成。

AI 绘画:支持多种绘图模型,你可以尽情发挥你的想象让CherryStudio帮你完成。

AI 翻译:无论是翻译页还是对话栏,CherryStudio都能快速翻译你输入的内容。

千余内置助手:CherryStudio内置了各种分类的千余助手,让你使用大模型更加高效。

多数据源知识库:无论是本地文件还是网页,都能作为知识源快速构建你的专属知识库。

多种备份方式:包括本地备份和云端备份,多个设备无忧切换,更便捷更安全。

云平台比较

测试基准

使用 Cherry Studio 工具进行三轮以上的测试,取最好的一次。

使用默认助手,每次提问不受提示词的影响,同时模型参数也保持一致。

每次提问都会清空上下文 ,保证上次回答不会影响下一次的结果。

统一使用 DeepSeek-R1 模型,且以深度思考时间作为耗时参考。

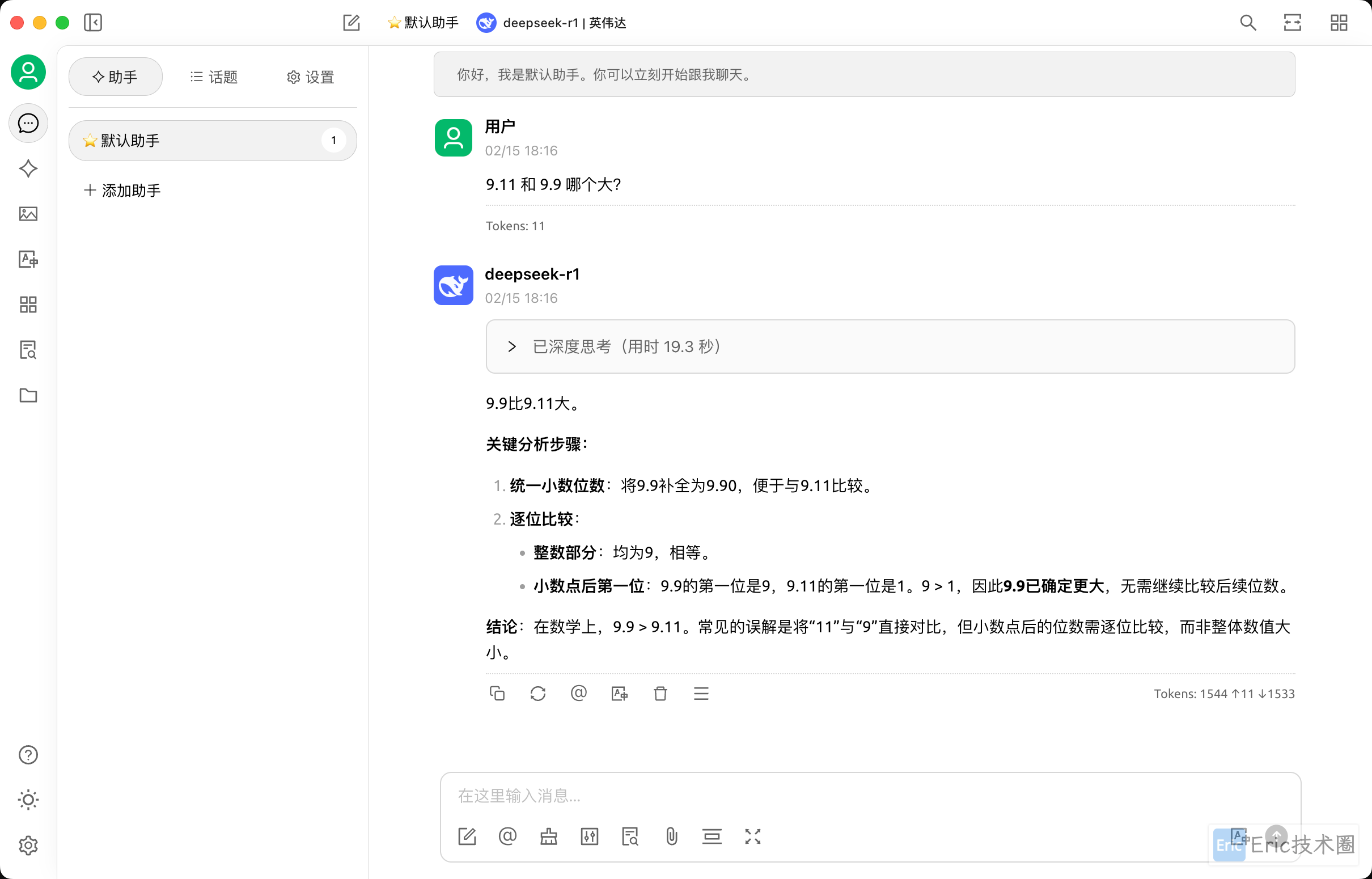

统一使用:“9.11 和 9.9 哪个大?” 作为基准问题进行提问。

以上是本人的一些测试依据,仅供参考。同时以下数据也可自行测试,都是满血版免费试用。

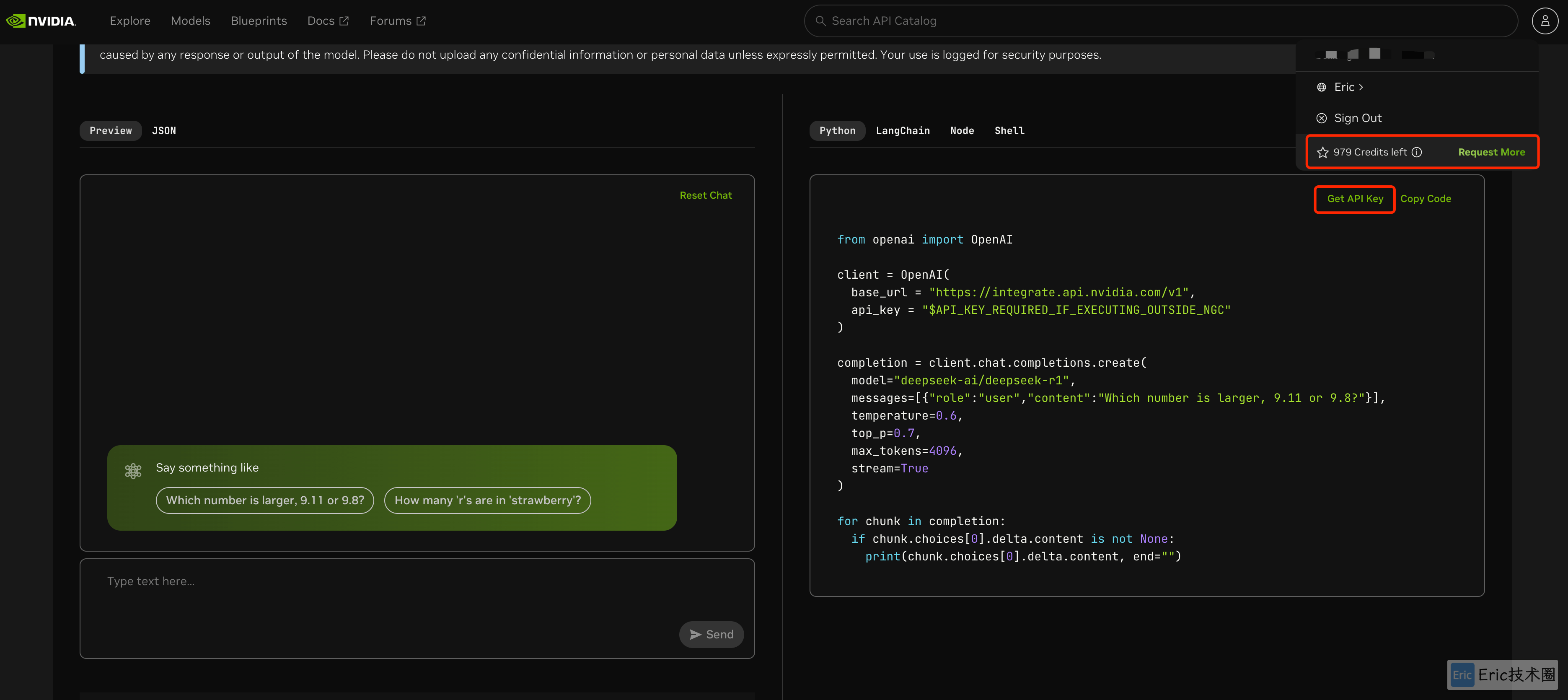

英伟达 Nvidia

注意:

通过邮件即可注册,不需要个人认证,国内的云平台都需要人脸识别来完成个人认证。

每个账号初始 1000 次调用额度,当然你可以通过无限注册邮箱来实现白嫖。

需要魔法工具才能调用 API,但是官网访问不受限制。

耗时测试:

三次深度思考用时分别是:19s、75s 和 25s,以下取最好的一次结果。

使用体验:

不亏是卖卡的,快的时候,响应飞速,但多次使用下来,感觉不是特别稳定,估计和魔法工具有关。

推荐指数:🌟🌟🌟🌟

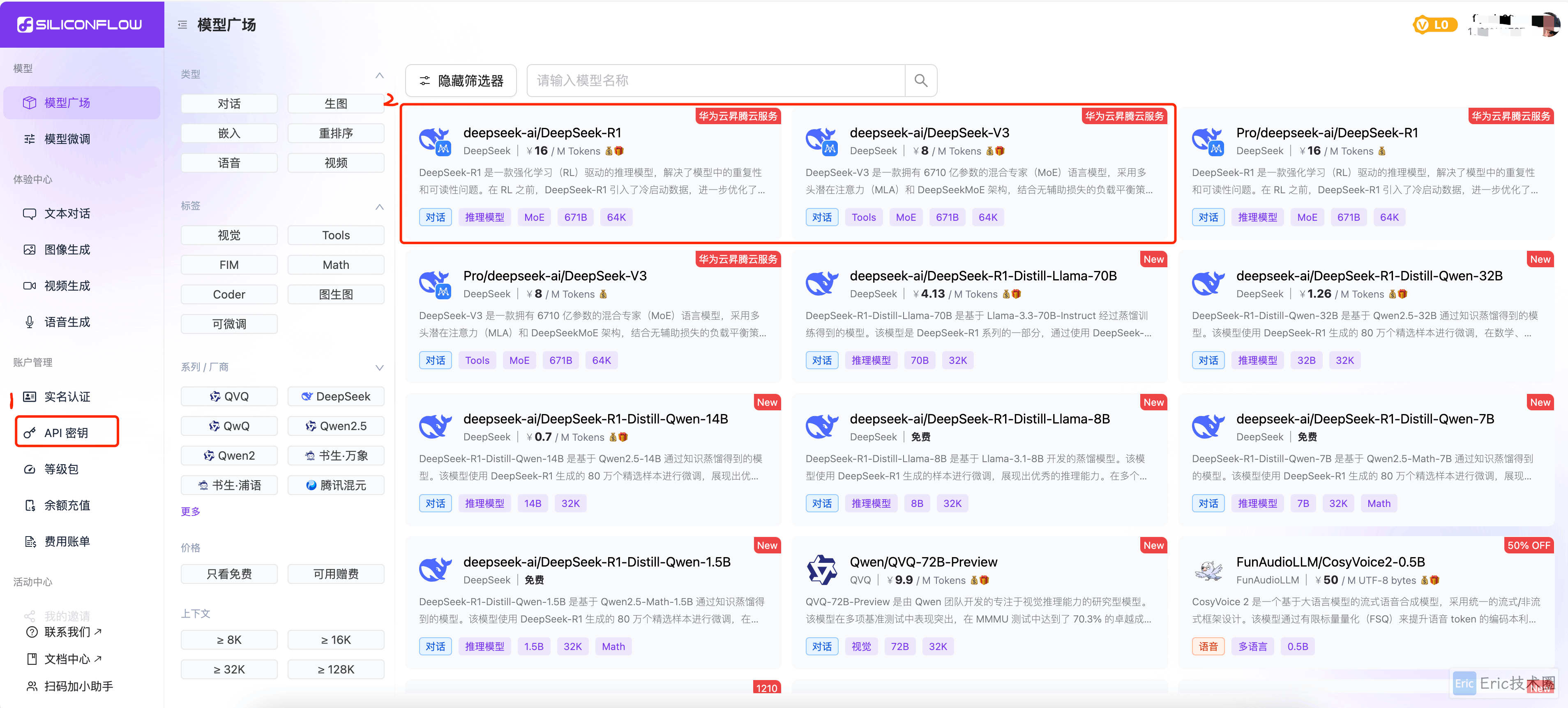

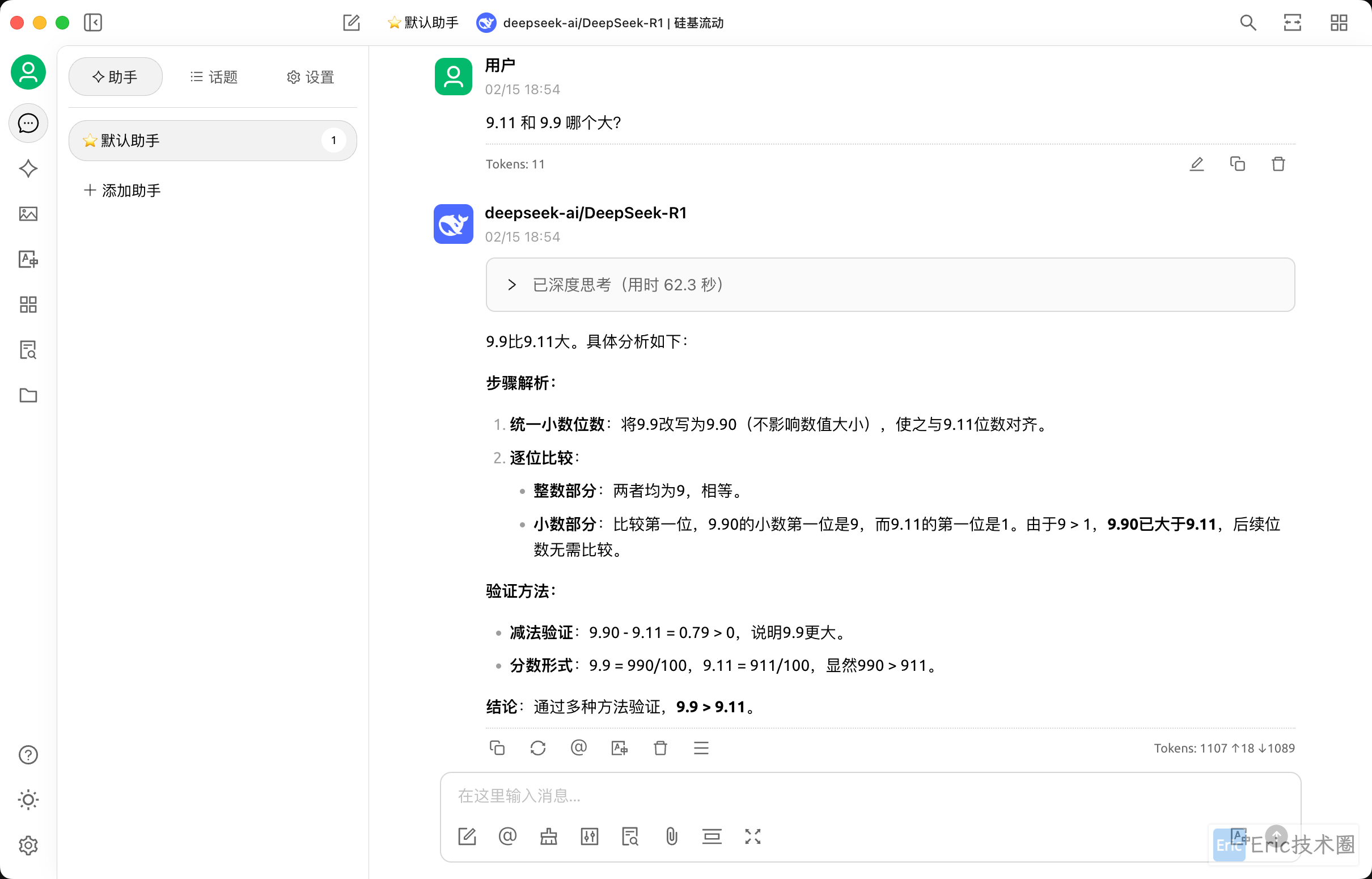

硅基流动

耗时测试:

三次深度思考用时分别是:62s、97s 和 106s,以下取最好的一次结果。

使用体验:

吐字速度较慢,大部分耗时都超过 60秒,差的时候有 100 多秒,偶尔卡顿。

推荐指数:🌟🌟

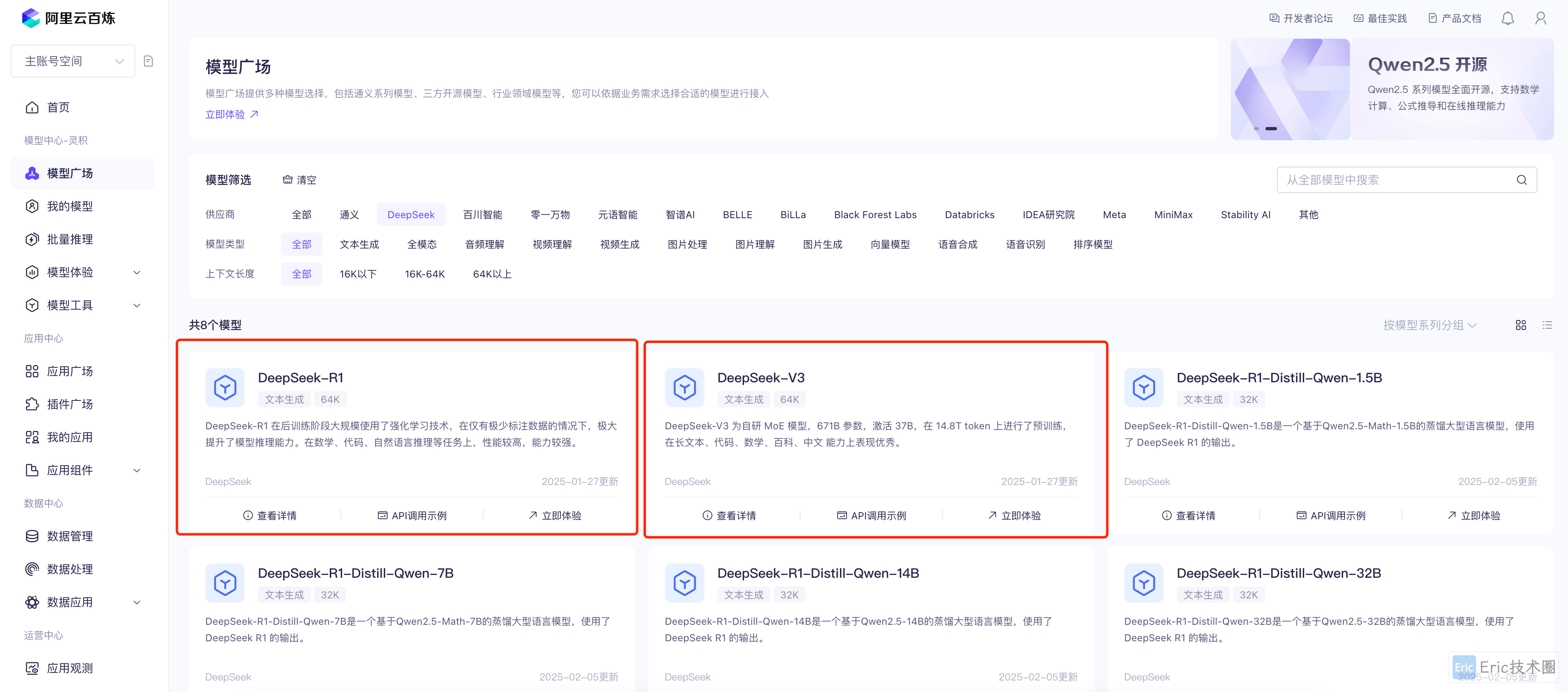

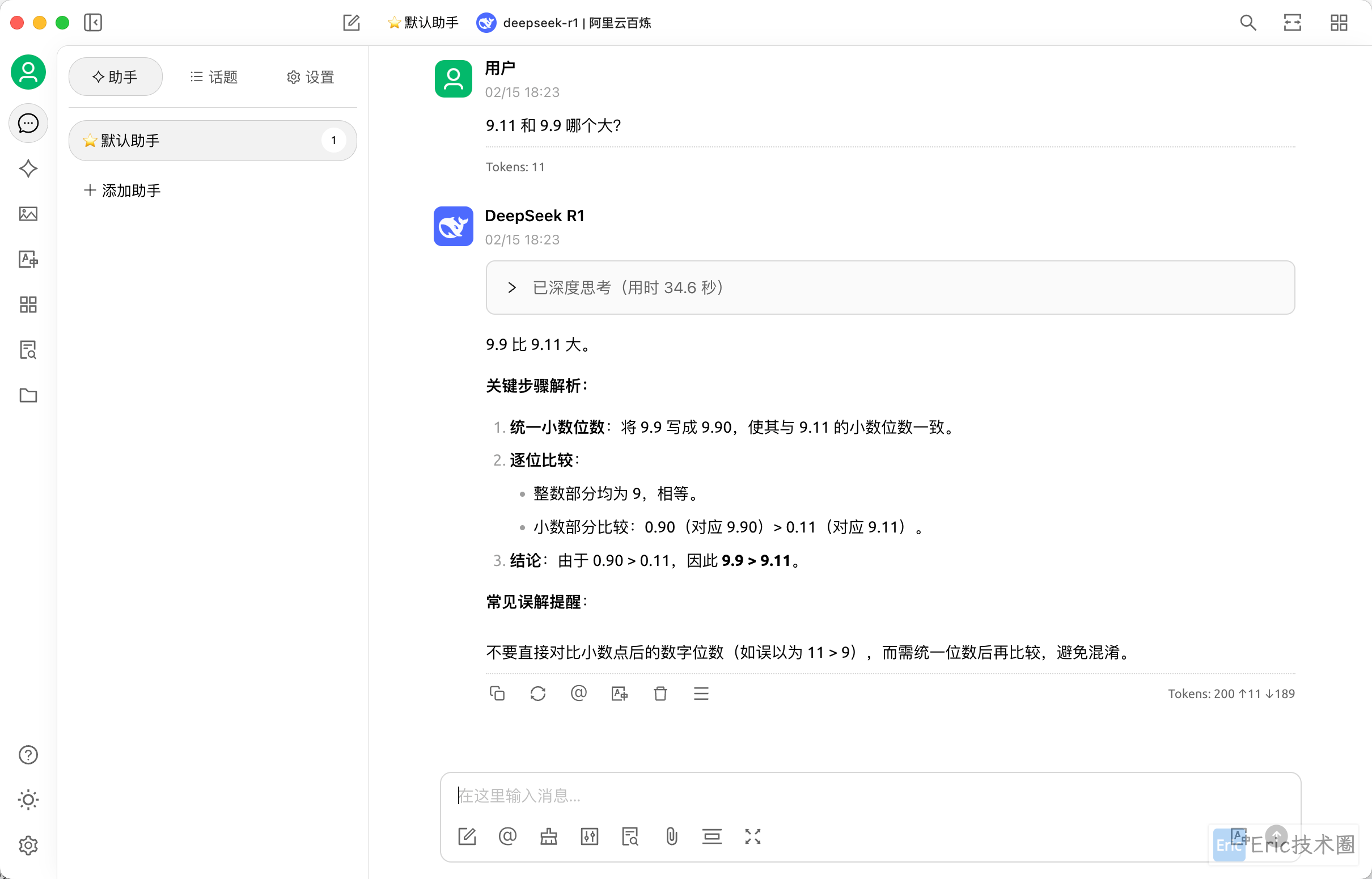

阿里云百炼

耗时测试:

三次深度思考用时分别是:34s、77s 和 38s,以下取最好的一次结果。

使用体验:

整体速度能够接受,但是偶尔不稳定,观察了下和推理失败,重新推理有些关系,比较推荐。

推荐指数: 🌟🌟🌟

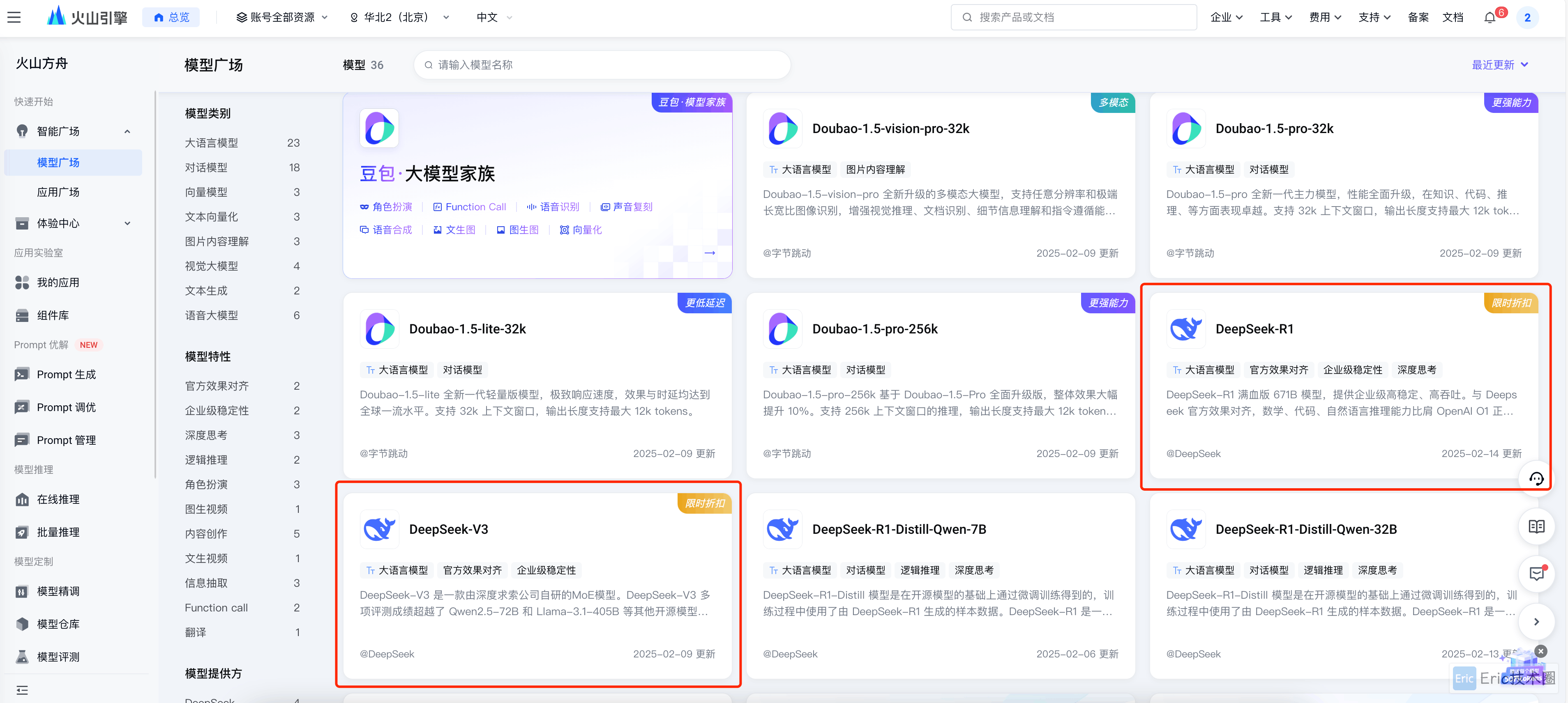

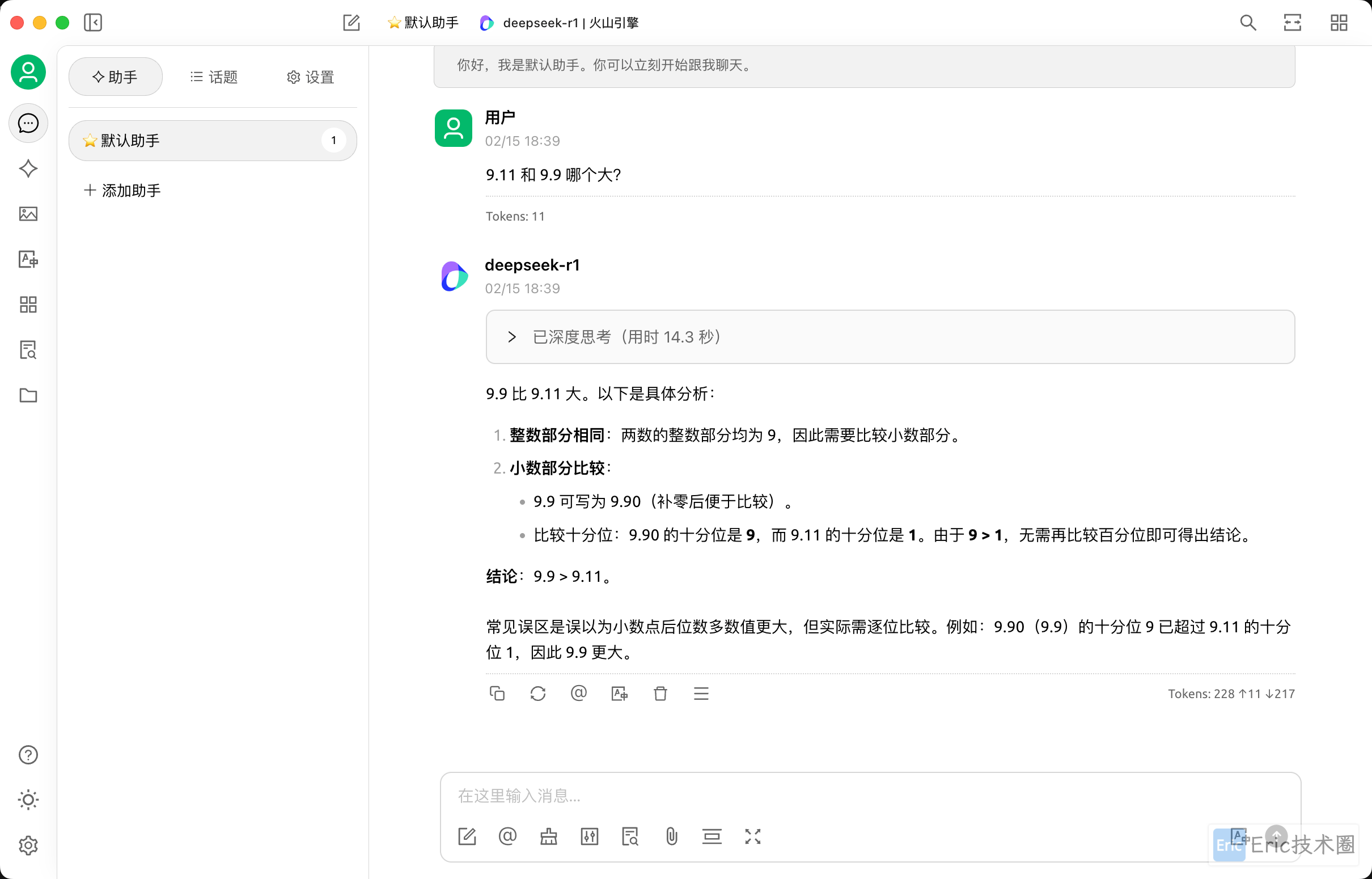

火山引擎

https://console.volcengine.com/ark/region:ark+cn-beijing/model?vendor=Bytedance&view=LIST_VIEW

耗时测试:

三次深度思考用时分别是:19s、14s 和 20s,以下取最好的一次结果。

使用体验:

出字速度很快,多次使用下来也很稳定。强烈推荐。

推荐指数:🌟🌟🌟🌟🌟

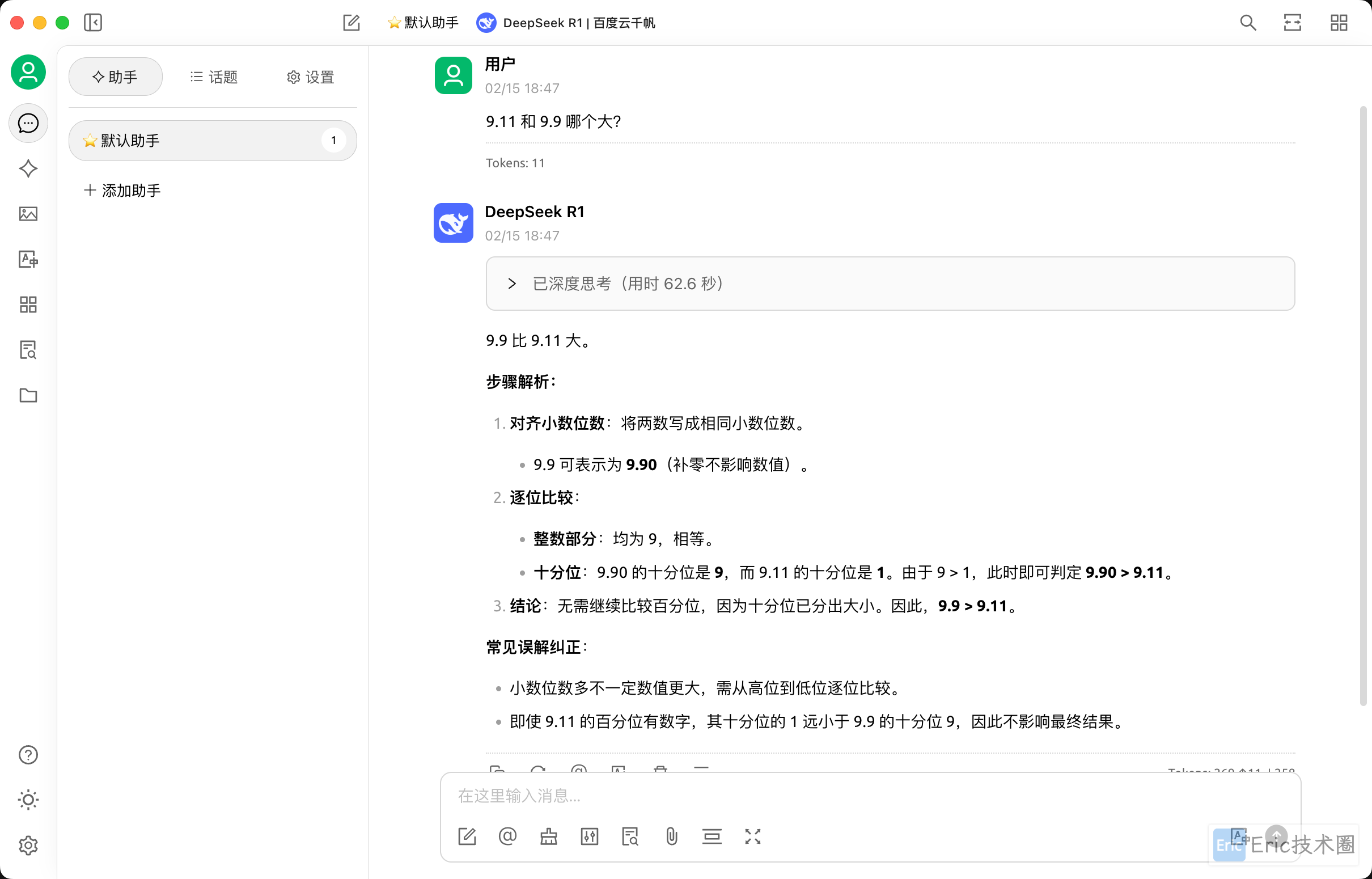

百度云千帆

https://console.bce.baidu.com/qianfan/modelcenter/model/buildIn/list

耗时测试:

三次深度思考用时分别是:86s、62s 和 69s,以下取最好的一次结果。

使用体验:

不单单深度思考的速度慢,之后的答案回复也很卡顿,在慢慢的吐字,体验不佳。

推荐指数:🌟🌟

最后

单从响应速度考虑的话,推荐如下:火山引擎 >= 英伟达 Nvidia > 阿里云百炼 > 百度云千帆 > 硅基流动。

不同时间段,不同云平台的负载情况不同,以上结果仅供参考。

欢迎关注我的公众号“Eric技术圈”,原创技术文章第一时间推送。